Wenn zwei Bilder genügen Wie KI die Zellsegmentierung alltagstauglicher macht

Anbieter zum Thema

Künstliche Intelligenz erleichtert die Zellsegmentierung – stößt im Laboralltag aber oft an Grenzen. Ein neuer Ansatz zeigt, dass bereits zwei gezielt ausgewählte Mikroskopiebilder ausreichen können, um vortrainierte KI-Modelle effektiv anzupassen und die Analyse deutlich zu verbessern.

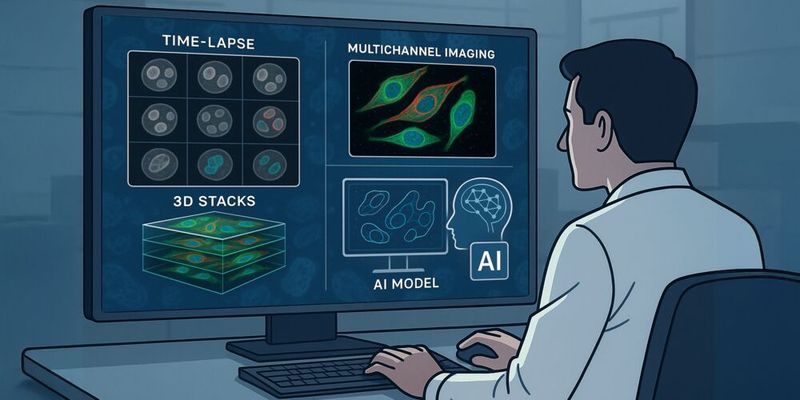

Digitale Bildanalyse ist aus modernen biomedizinischen Laboren kaum noch wegzudenken. Hochauflösende Mikroskope erzeugen heute in kurzer Zeit riesige Datenmengen: Zeitraffersequenzen, Mehrkanalaufnahmen, 3D-Stacks. Um diese Bilder quantitativ auszuwerten, setzen viele Labore inzwischen auf KI-basierte Werkzeuge, die Zellen automatisch erkennen und segmentieren. Wenn die Aufnahmen klar, kontrastreich und „lehrbuchartig“ sind, liefern solche Systeme oft erstaunlich gute Ergebnisse – und sparen enorm viel Zeit.

Doch der Laboralltag sieht selten so ideal aus. Reale Mikroskopiedaten sind komplex: Zellen überlagern sich, Kontraste sind schwach, Fokusebenen variieren, Artefakte treten auf, und selbst Proben aus demselben Experiment können je nach Mikroskop, Objektiv oder Färbung deutlich unterschiedlich aussehen. Unter solchen Bedingungen stoßen „out-of-the-box“-Modelle schnell an ihre Grenzen. Die Segmentierung wird unzuverlässig, und kleine systematische Fehler können sich in nachgelagerten Analysen massiv auswirken.

Melden Sie sich an oder registrieren Sie sich und lesen Sie weiter

Um diesen Artikel vollständig lesen zu können, müssen Sie registriert sein. Die kostenlose Registrierung bietet Ihnen Zugang zu exklusiven Fachinformationen.

Sie haben bereits ein Konto? Hier einloggen

:quality(80)/p7i.vogel.de/wcms/43/0e/430e4c2529fb31bdb5c2500f04ed707c/0130440929v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/2e/33/2e332f329ccf6ef295ee35a9d5049b8b/0130399316v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/26/b2/26b2186fd88321e398984332169f59f0/0129722903v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/e7/e1/e7e14971b1dc6a6a0f18859498ec2a89/0129747612v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/24/73/24731ba3fd52be5987fe51d642856c07/0130441034v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/71/29/71295d1eb7f0ad16bdf44bd7f866a5b0/0130415675v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/95/6e/956ea79d99f32093405a3272328a6737/0130137708v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/9c/2f/9c2fb6d69de09abd5fd9ab434437c751/0129634837v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/ac/93/ac9380952d1da4eb0ab967b1f0a32b03/0129719174v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/bb/03/bb032ceb9559ab36fc68e0becfd96de9/0130195320v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/64/74/64741aaf6a9dd0141605bda58b33ee22/0130364539v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/bc/ab/bcab50dc3564311840320fdc57911664/0130215282v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/0a/f4/0af4c9ecfe8fa2636905ca43f2d46b7e/0130039671v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/82/eb/82eb81266875366e08e845aaed3e6ed5/0130463403v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/2e/17/2e1795b6750cc3eaad6ba81c0bc79d16/0100811496v7.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/69/67/696769fab6999/kern-logo2023-blau-4c-or.png)

:fill(fff,0)/images.vogel.de/vogelonline/companyimg/20500/20552/65.jpg)

:fill(fff,0)/p7i.vogel.de/companies/60/dd/60ddc39947ebf/brand-logo-registered.png)

:quality(80)/p7i.vogel.de/wcms/2f/48/2f48521607cca44c952cb043ae507bd9/0124305109v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/b1/7a/b17a1957b45bcc9acbba24ec709f824c/0126987477v3.jpeg)