Wie der Kortex Sinnesreize verarbeitet Sehen oder hören – was bekommt mehr Aufmerksamkeit im Gehirn?

In der Großstadt buhlen blinkende Reklametafeln und hupende Autos um unsere Aufmerksamkeit. Unser Gehirn muss stets entscheiden, welche Reize gerade im Fokus stehen sollen. Wie diese Wahl im Wettstreit zwischen visuellen und auditiven Reizen ausfällt, haben Forscher nun im MRT-Experiment sichtbar gemacht.

Anbieter zum Thema

Leipzig – Überqueren wir mit Blick aufs Smartphone eine Straße, lässt uns ein warnendes Hupen oder Motorengeräusch aufschrecken. Im Alltag können wir mühelos Informationen von verschiedenen Sinnen zusammenführen und unsere Aufmerksamkeit von einem Sinneseingang auf einen anderen verlagern – etwa vom Sehen auf das Hören. Doch wie entscheidet das Gehirn beim Zusammenspiel beider Sinne, auf welchen es die übergreifende Aufmerksamkeit lenkt? Und wie spiegeln sich diese Mechanismen in der Hirnstruktur wider?

Um das zu beantworten, haben Wissenschaftler des Max-Planck-Instituts für Kognitions- und Neurowissenschaften (MPI CBS) in Leipzig und des Computational Neuroscience and Cognitive Robotics Centre der University of Birmingham beobachtet, wie das Gehirn Sinnesreize verarbeitet. Im Gegensatz zu bisherigen Studien haben sie dabei nicht nur gemessen, an welchen Stellen die Großhirnrinde auf der Oberfläche aktiviert wird. Sie haben erstmals auch nach stärkeren Signalen in der Tiefe gesucht. Die Ergebnisse der Forscher deuten darauf hin, dass unser Gehirn den Informationsfluss über ausgeprägte Schaltkreise bis in die kleinsten Windungen dieser stark gefalteten Hirnstruktur leitet.

Bild und Ton im Magnetresonanztomographen

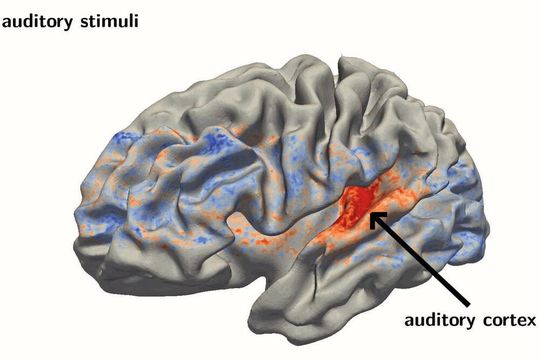

Während die Teilnehmer der Studie im Magnetresonanztomographen (MRT) lagen, zeigten die Wissenschaftler ihnen Symbole auf einem Bildschirm und spielten ihnen gleichzeitig Geräusche vor. Davor waren die Studienteilnehmer gebeten worden, ihre Aufmerksamkeit entweder auf den hörbaren oder den sichtbaren Teil des Experiments zu richten.

Die Neurophysiker analysierten im Anschluss, an welchen Stellen die Sinnesreize verarbeitet werden – und mussten dabei mit zwei Schwierigkeiten umgehen. „Die Hirnrinde ist nur zwei bis drei Millimeter dick. Wir benötigten also eine sehr hohe räumliche Auflösung von unter einem Millimeter während der Datenaufnahme“, erklärt Robert Trampel, der die Studie am MPI CBS mitbetreut hat. „Durch die dichte Faltung der Hirnrinde mussten wir sie außerdem virtuell glätten und in verschiedene Schichten zerlegen, um die Signale genau orten zu können.“

Bei Geräuschen schaltet der visuelle Hirnteil weitgehend ab

Die Auswertung brachte neue Einblicke, wie unser Gehirn verschiedene Reize verarbeitet: Hörten die Teilnehmer ein Geräusch, schaltete sich bei ihnen der visuelle Teil des Gehirns weitgehend ab – unabhängig davon, ob sie ihre Aufmerksamkeit auf den hörbaren oder den sichtbaren Teil des Experiments richteten. Achteten sie verstärkt auf das Geräusch, verringerte sich vor allem in den Regionen die Hirnaktivität, die dem Zentrum des Gesichtsfeldes entsprechen. Geräusche lenken unsere Aufmerksamkeit also stark von dem ab, was wir gerade betrachten.

In den Regionen, die fürs Hören zuständig sind, machten die Forscher zudem eine Neuentdeckung. Sie stellten fest, dass sich das Aktivierungsprofil entlang der verschiedenen Schichten der Großhirnrinde veränderte, wenn den Teilnehmern ausschließlich Geräusche präsentiert wurden. Anders hingegen, wenn die Studienteilnehmer nur „etwas fürs Auge“ wahrnahmen: Dann gab es keine Veränderungen. Gau resümiert: „Wenn wir also gleichzeitig verschiedene Sinneseindrücke verarbeiten müssen, werden auch verschiedene Verschaltungen von Neuronen aktiv – je nachdem, worauf wir unsere Aufmerksamkeit richten. Das konnten wir nun durch neuartige Experimente am Computer sichtbar machen.“

Originalpublikation: Remi Gau, Pierre-Louis Bazin, Robert Trampel, Robert Turner, Uta Noppeney: Resolving multisensory and attentional influences across cortical depth in sensory cortices, eLife 2020;9; DOI: 10.7554/eLife.46856

* B. Hennebach, Max-Planck-Institut für Kognitions- und Neurowissenschaften, 04103 Leipzig

(ID:46358175)

:quality(80)/p7i.vogel.de/wcms/c9/16/c9162be8c6014187286dda23e57f8793/0130654555v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/9f/9d/9f9d6fc46606d654deca536f05102f7a/0130752952v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/bb/58/bb58da17d7bb11b44fcae8d06c35df76/0130791510v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/0f/0c/0f0c5774037cc09a3536d24702f6204b/0130936383v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/dc/7b/dc7b0f7209d2dedf548b5019da2e1b9c/0130556742v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/bf/30/bf3038b92e4988d6c883c155ef727153/0130924147v3.jpeg)

:quality(80)/p7i.vogel.de/wcms/a6/e0/a6e0ab14cf7f6b22d536f6ca6e5fb777/0130793394v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/63/85/638523e67603079a004bbd3a99b6ad92/0130856502v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/2d/5f/2d5f14d92ec22f38682c6d240600579f/0131000090v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/19/40/194054b15f3c0e161583d7ea8917ec3f/0130974372v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/5a/25/5a251d7c5cce7101518c9b16850267f1/0130561986v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/5d/5d/5d5de6cfa0d711a690b108f9a29bad35/0130932970v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/09/88/09883aaf7db3151a2e894d56c2a515d4/0130982666v2.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/60/dd/60ddc39947ebf/brand-logo-registered.png)

:fill(fff,0)/images.vogel.de/vogelonline/companyimg/84700/84716/65.jpg)

:fill(fff,0)/images.vogel.de/vogelonline/companyimg/100900/100932/65.gif)

:quality(80)/p7i.vogel.de/wcms/18/76/187621b7ac0af475d3157f6d82f6f4af/0126143864v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/74/e5/74e54751d091088ba67620f4d6aa478f/0125296978v2.jpeg)